Google розширює сімейство моделей штучного інтелекту трьома новими варіантами Gemini 2.0, кожен з яких призначений для різних варіантів використання і пропонує різний баланс продуктивності та вартості.

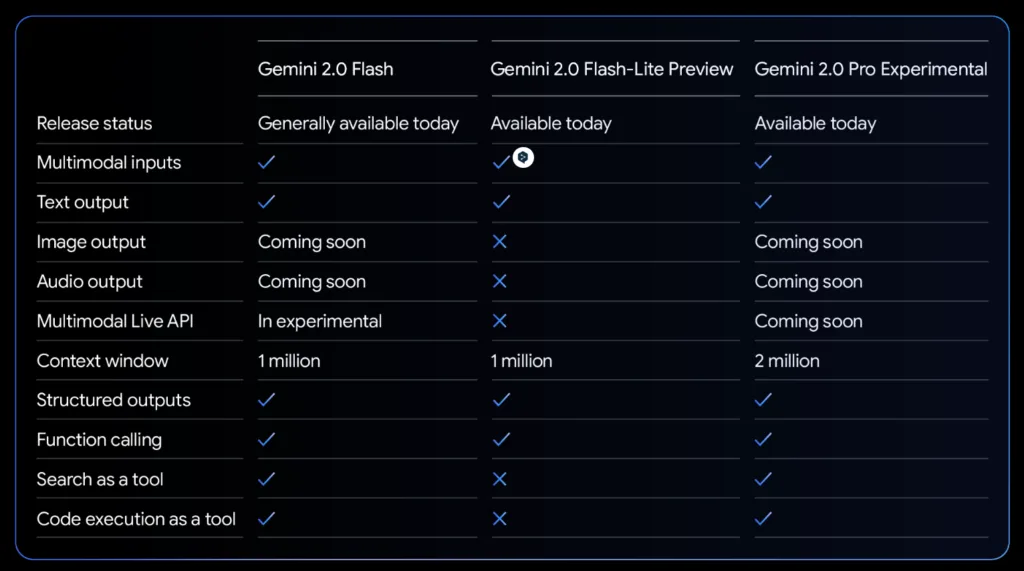

Базова модель Gemini 2.0 Flash, представлена в грудні, тепер доступна всім охочим з більш високими обмеженнями швидкості та поліпшеною продуктивністю, повідомляє Google. Google також запускає Gemini 2.0 Flash-Lite, економічний варіант для розробників, який наразі перебуває в публічній попередній версії через API.

Завершує лінійку Gemini 2.0 Pro, яку Google описує як все ще експериментальну. Розроблена для складних запитів і завдань програмування, вона має розширене контекстне вікно у 2 мільйони токенів – удвічі більше, ніж у версій Flash. Хоча наразі моделі підтримують тільки текстовий вивід, Google планує додати можливості зображень і аудіо, а також живе відео у Flash і Pro найближчими місяцями. Усі три моделі можуть обробляти зображення та аудіо як вхідні дані.

Google також тестує моделі Flash Thinking з Gemini 2.0 , які працюють аналогічно OpenAI o3 і Deepseek-R1, виконуючи додаткові кроки міркування перед генерацією відповідей. Ці моделі можуть отримувати доступ до YouTube, Карт і Пошуку Google. Примітно, що в анонсі відсутня флагманська модель «Gemini 2.0 Ultra».

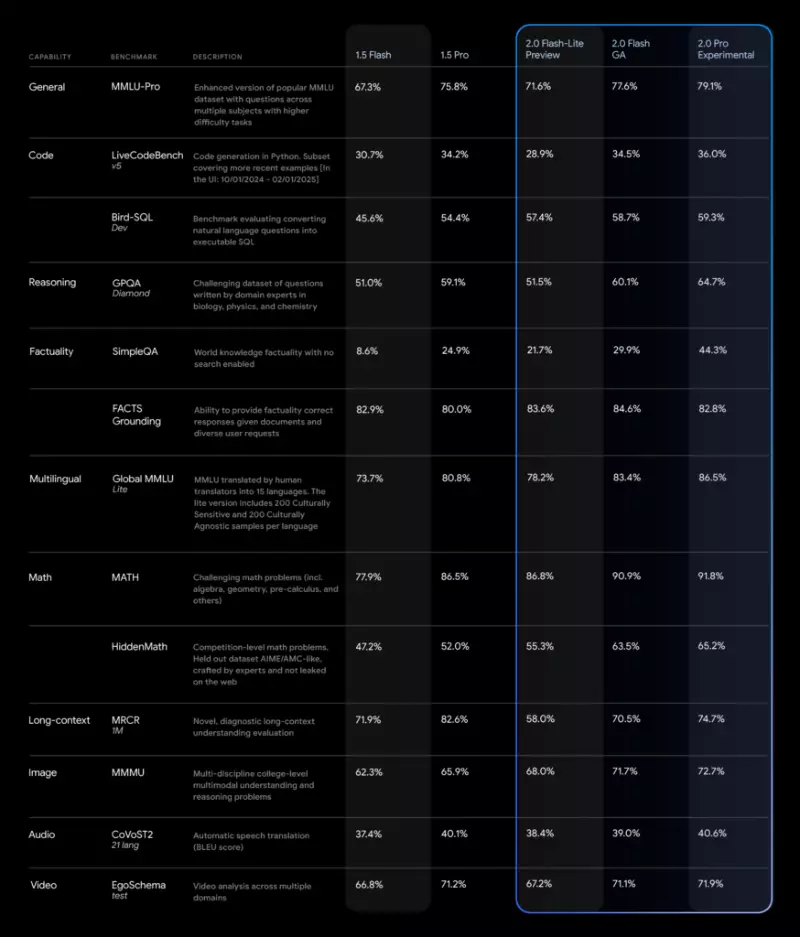

Дані бенчмарків Google показують, що Gemini 2.0 Pro перевершує своїх попередників майже у всіх сферах. Для математичних завдань він набирає 91,8% у тесті MATH і 65,2% у HiddenMath, значно перевершуючи варіанти Flash. Загальна версія Flash 2.0 набирає проміжні бали між Flash Lite і Pro і перевершує стару модель 1.5 Pro.

У тесті SimpleQA OpenAI модель Pro досягла 44,3%, а Gemini 2.0 Flash – 29,9%. Deepseek-R1 (30,1%) і o3-mini-high (13,8%) значно відстають у цьому тесті, ймовірно, через менші набори даних для навчання. Тест вимагає, щоб моделі відповідали на складні фактичні запитання без доступу до інтернету – хоча це може бути менш актуальним для реальних додатків.

Для ціноутворення API Google прибрала колишню відмінність між короткими і довгими контекстними запитами. Це означає, що змішані робочі навантаження (текст і зображення) можуть коштувати менше, ніж з Gemini 1.5 Flash, незважаючи на поліпшення продуктивності.

Загалом Gemini 2.0 Flash дорожчий за свого попередника. Однак новий Flash-Lite розроблений для конкуренції зі старим 1.5 Flash – він коштує стільки ж і працює краще в більшості тестів. Тільки реальні тести покажуть, чи забезпечують дві моделі порівнянну якість.

Усі моделі доступні через Google AI Studio і Vertex AI, а також через преміум чат-бот Gemini Advanced від Google на комп’ютерах і мобільних пристроях.